AIは「理由を言わない名人」― ブラックボックスとハルシネーションを知る

〜 安全にAIを使いこなすための基礎知識 〜

「AIってすごいけど、なんでその答えになったの?」

「もっともらしいこと言ってたのに、調べたら間違いだった…」

AIを使っていると、こんな経験をすることがあります。

実は、これらはAIが抱える根本的な課題であり、知らずに使うと思わぬ失敗を招くことも。

今回は、AIを安全に使いこなすために知っておくべき2つの問題「ブラックボックス問題」と「ハルシネーション」について、農家の視点から分かりやすく解説します。

🔲 ブラックボックス問題とは?

「なぜその答えなのか」が分からない

AIに質問すると、驚くほど的確な回答が返ってくることがあります。

でも、「なぜその答えになったのか」は、AI自身も説明できないのです。

これが「ブラックボックス問題」です。

ブラックボックス=中身が見えない箱

入力(質問)を入れると、出力(回答)は出てくる。

でも、途中で何が起きているかは誰にも分からない。

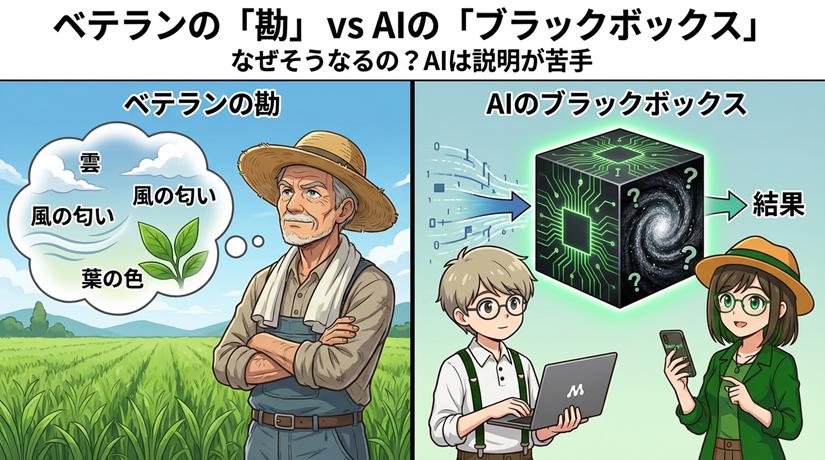

🌾 農業で例えると「理由を言わない名人」

この問題、実は農業の世界にも似たような存在がいます。

「勘」で的中させるベテラン農家

あなたの周りにも、こんな先輩農家はいませんか?

「今年は梅雨明けが早いから、〇〇の時期を1週間前倒しにしろ」

聞くと当たる。でも理由を聞くと…

「なんとなく分かるんだよ」

長年の経験から「勘」で正解を導き出せる。でも、なぜそうなのかは言葉にできない。

AIも同じなんです。

人間の「勘」とAIの「ブラックボックス」の違い

| ベテラン農家の勘 | AIのブラックボックス | |

|---|---|---|

| 正解率 | 高いことが多い | 高いことが多い |

| 理由の説明 | 難しい(経験則) | できない(仕組み上) |

| 間違えたとき | 経験から原因を推測できる | 原因が全く分からない |

| 改善方法 | 次に活かせる | 何を直せばいいか不明 |

ベテラン農家は間違えても「なぜ間違えたか」を振り返れる。

でもAIは、間違えても「なぜ間違えたか」が分からない。

農業での具体例

例えば、AIに「トマトの葉が黄色くなった原因」を聞いたとします。

あなたはその通りに追肥した。でも改善しなかった。

実際の原因は「根腐れによる養分吸収不良」だった。

このとき、なぜAIが「窒素欠乏」と判断したのかが分からないため、次にどう質問を改善すればいいかも分からないのです。

🎭 ハルシネーションとは?

「もっともらしい嘘」をつく問題

もう一つの大きな問題が「ハルシネーション」です。

英語で「幻覚」という意味。

AIが、あたかも事実であるかのように「でたらめ」を答える現象のことです。

しかも厄介なのは、自信満々に、もっともらしく答えること。

🍅 農業で例えると「見た目は立派、中身はスカスカ」

ハルシネーションを農業で例えるなら、こんな感じです。

例え①:見た目は完璧なのに中身がない野菜

市場で見かける、見た目はツヤツヤで立派なトマト。

でも食べてみると…

「味が薄い…水っぽい…」

外見は100点。でも中身が伴っていない。

AIのハルシネーションも同じです。

回答の「見た目」は完璧。文法も正しいし、専門用語も使っている。

でも中身(事実)が伴っていないことがある。

例え②:病害虫の誤診断

こんな場面を想像してください。

あなたがAIに写真を見せて聞きました。

「この葉っぱの症状は何ですか?」

自信満々の回答。あなたは言われた通りに薬剤を散布。

でも実際はハダニの被害だった。

結果、的外れな対策で時間とコストを無駄にした。

なぜハルシネーションは起きるのか?

AIは「正しい答えを探す」のではなく、「それっぽい答えを生成する」仕組みで動いています。

| 人間の回答 | AIの回答 |

|---|---|

| 知らないことは「分からない」と言える | 知らなくても「それっぽい答え」を作ってしまう |

| 自信がないときは態度に出る | 常に自信満々に見える |

| 嘘をつくと罪悪感がある | 嘘をついている自覚がない |

AIには「分かりません」という謙虚さがないのです。

だから、知らないことでも、あたかも知っているかのように答えてしまう。

⚠️ 実際に起きた「AIの嘘」の例

ハルシネーションは、実際に様々な場面で問題を起こしています。

事例:存在しない論文を引用

ある研究者がAIに「〇〇に関する論文を教えて」と質問。

AIは自信満々に論文タイトル、著者名、掲載誌まで回答。

でも調べてみると…その論文は存在しなかった。

AIが「それっぽい」論文情報をでっち上げていたのです。

農業で起きうるリスク

| 質問内容 | ハルシネーションのリスク |

|---|---|

| 農薬の希釈倍率 | 間違った濃度で薬害発生 |

| 補助金制度の詳細 | 存在しない制度を案内される |

| 病害虫の対処法 | 的外れな対策で被害拡大 |

| 法規制の確認 | 誤った情報で違反してしまう |

「数字」「固有名詞」「最新情報」は要注意です。AIが最も間違えやすい分野です。

🛡️ 農家がAIを安全に使うための5つの心得

では、これらの問題を知った上で、どうAIと付き合えばいいのでしょうか?

「知らない分野」では頼りすぎない

自分が間違いに気づけない分野では、AIを鵜呑みにしない。逆に、あなたが詳しい分野なら、AIの回答をチェックできる。AIは「下書き」や「アイデア出し」として使い、最終判断は自分でする。

「数字」と「固有名詞」は必ず確認

農薬の希釈倍率、補助金の金額、制度の名称…必ずダブルチェック。特に農業では、農薬の希釈倍率を間違えると薬害や残留基準超過につながります。必ず公式資料や専門家に確認しましょう。

「いつの情報か」を意識する

AIは「過去の情報」で学習している。最新情報は持っていない。今年から変わった補助金制度、最近登録された新しい農薬、今年の気象予報など、最新情報はAIの苦手分野です。

「なぜ?」と聞いてみる

回答の根拠を聞くことで、怪しさに気づける。「なぜそう言えるのですか?根拠を教えてください」と追加で聞いてみましょう。説明が曖昧だったり、矛盾していたら要注意。

複数のソースで確認する習慣

AIの回答を1つの「参考意見」として捉え、別の情報源でも確認する習慣をつけましょう。AIの回答 + 別の情報源 = 安心。

確認すべき情報源の例

| AIの回答内容 | 確認すべき情報源 |

|---|---|

| 病害虫の対処法 | 農協の営農指導、専門書 |

| 農薬の使用方法 | 農薬ラベル、メーカー公式 |

| 補助金・制度 | 農水省・自治体の公式HP |

| 栽培技術 | 試験場のレポート、先輩農家 |

🌱 AIは「優秀だけど新人の従業員」

ここまで読んで、「AIって危ないの?」と思った方もいるかもしれません。

でも、考え方を変えてみてください。

AIを「新人従業員」に例えると

| 特徴 | 優秀な新人 | AI |

|---|---|---|

| 知識量 | 勉強熱心で詳しい | 膨大な情報を持っている |

| スピード | 仕事が速い | 瞬時に回答 |

| やる気 | いつでも全力 | 24時間対応 |

| 経験 | まだ浅い | 現場経験ゼロ |

| 判断力 | 時々間違える | 時々間違える |

| 責任 | 最終責任は上司 | 最終責任はあなた |

優秀だけど、経験が浅くて時々間違える新人。

あなたはその新人の仕事を、ノーチェックで通しますか?

きっと、確認してから承認するはずです。

AIも同じ。便利なアシスタントだけど、最終確認は人間がする。

この感覚を持っておけば、安全に使いこなせます。

📋 チェックリスト:AIの回答を受け取ったら

AIから回答をもらったら、以下をチェックしてみてください。

- 自分の知識・経験と照らして違和感はないか?

- 具体的な数字は公式資料で確認したか?

- 固有名詞(制度名、農薬名など)は実在するか?

- 「なぜ?」と聞いて、根拠は明確か?

- 最新情報が必要な内容ではないか?

- 他の情報源でも確認したか?

全部チェックする必要はありません。

「これは重要だ」と思う情報だけ、確認する習慣をつけましょう。

📌 まとめ

ブラックボックス問題

- AIは「なぜその答えなのか」を説明できない

- 間違えたとき、原因が分からず改善しにくい

- → 理由を言わない名人。当たることも多いが、外れたとき困る

ハルシネーション

- AIは「もっともらしい嘘」を自信満々につく

- 知らないことでも「それっぽく」答えてしまう

- → 見た目は立派、中身はスカスカな回答がある

農家がAIを安全に使うために

- 知らない分野では頼りすぎない

- 数字と固有名詞は必ず確認

- 最新情報はAIの苦手分野と心得る

- 「なぜ?」と根拠を聞いてみる

- 複数のソースで確認する

🌾 最後に:だからこそ「農家の経験」が活きる

AIには限界があります。

でも、その限界を知った上で使えば、AIは最強のパートナーになります。

そして何より、AIの間違いに気づけるのは、現場経験を持つあなた自身です。

長年培ってきた知識、五感で感じ取る変化、地域の特性への理解。

これらは、どんなAIも持っていません。

AIは道具。使いこなすのは人間。

判断するのは、現場を知るあなた。

この意識を持って、AIを味方につけていきましょう。

📚 参考

- 書籍『AI vs. 教科書が読めない子どもたち』(新井紀子 著)

- 書籍『AI DRIVEN:AIで進化する人類の働き方』(伊藤穰一 著)

- 書籍『Web3とメタバースは人間を自由にするか』(佐々木俊尚 著)

5分で試せるアクション

今日のチャレンジ:AIに「なぜ?」と聞いてみよう

1. ChatGPTを開く

2.何か1つ質問をする(例:「トマトの尻腐れ病の原因は?」)

3.回答が返ってきたら「なぜそう言えるのですか?根拠を教えてください」と追加で聞く

4.根拠の説明が具体的か、曖昧かを確認してみる

5.可能なら、別の情報源(専門書やWebサイト)でも確認してみる

所要時間:約5分

✉️読者の声をお聞かせください

感想、実践報告、読みたい記事のリクエストなど、お気軽にお寄せください!

※ この記事はAIツール(ChatGPT・Claude等)を活用して作成し、編集部が内容を確認・編集しています。正確性には十分配慮していますが、最新情報は公式サイト等でご確認ください。